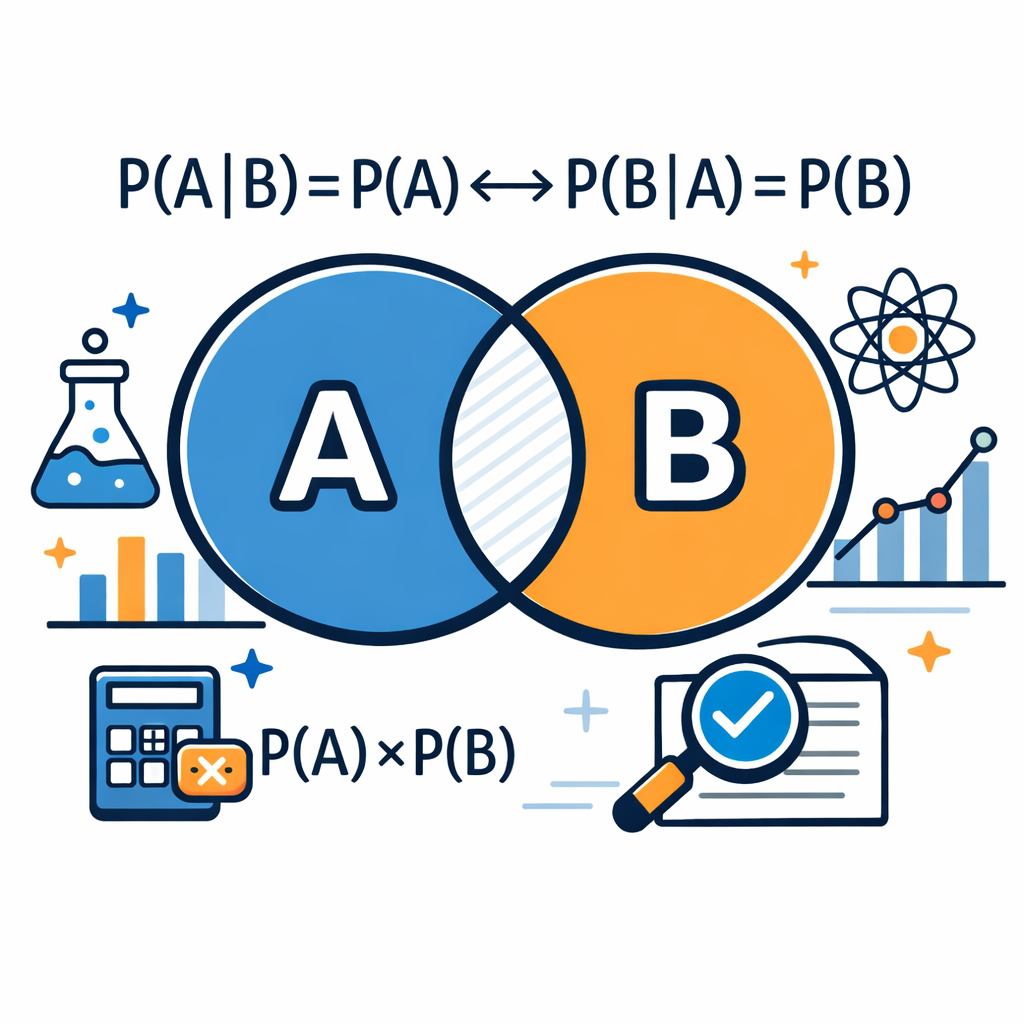

استقلال متقارن: از P(A|B)=P(A) به P(B|A)=P(B) میرسیم

مفهوم پایه: احتمال شرطی و استقلال

برای درک استقلال متقارن، ابتدا باید با دو مفهوم پایهای آشنا شویم: احتمال شرطی و تعریف استقلال. احتمال شرطی یعنی احتمال وقوع یک پیشامد، با دانستن اینکه پیشامد دیگری رخ داده است. اگر A و B دو پیشامد از یک فضای نمونه باشند، احتمال شرطی A به شرط B به صورت زیر تعریف میشود:

حال میرسیم به تعریف استقلال. دو پیشامد A و B مستقل نامیده میشوند اگر وقوع یا عدم وقوع یکی بر احتمال وقوع دیگری تأثیری نداشته باشد. به عبارت دیگر:

- A از B مستقل است اگر: $P(A|B) = P(A)$.

- B از A مستقل است اگر: $P(B|A) = P(B)$.

در نگاه اول، ممکن است این دو شرط جداگانه به نظر برسند. اما خاصیت استقلال متقارن به ما میگوید که این دو شرط در واقع معادل یکدیگر هستند. اگر یکی از آنها برقرار باشد (با فرض ناصفر بودن احتمالها)، دیگری نیز خودبهخود برقرار خواهد شد. این ویژگی از آنجا ناشی میشود که هر دو شرط در نهایت به یک رابطه سادهتر ختم میشوند: $P(A \cap B) = P(A) \cdot P(B)$.

اثبات گامبهگام استقلال متقارن

برای اثبات اینکه از رابطه $P(A|B)=P(A)$ نتیجه میشود $P(B|A)=P(B)$، تنها کافی است از تعریف احتمال شرطی و یک جابهجایی ساده استفاده کنیم. فرض میکنیم $P(A) \neq 0$ و $P(B) \neq 0$.

- از رابطه مفروض $P(A|B)=P(A)$ شروع میکنیم.

- طبق تعریف احتمال شرطی: $P(A|B) = \frac{P(A \cap B)}{P(B)}$.

- بنابراین داریم: $\frac{P(A \cap B)}{P(B)} = P(A)$.

- دو طرف رابطه را در $P(B)$ ضرب میکنیم تا به رابطه ضرب probability برسیم: $P(A \cap B) = P(A) \cdot P(B)$.

- اکنون میخواهیم $P(B|A)$ را حساب کنیم. طبق تعریف: $P(B|A) = \frac{P(B \cap A)}{P(A)}$. از آنجایی که اشتراک پیشامدها خاصیت جابهجایی دارد ($P(A \cap B) = P(B \cap A)$)، میتوانیم از رابطه مرحله قبل استفاده کنیم.

- با جایگذاری: $P(B|A) = \frac{P(A) \cdot P(B)}{P(A)}$.

- با سادهسازی کسر (چون $P(A) \neq 0$)، به نتیجه مطلوب میرسیم: $P(B|A) = P(B)$.

به این ترتیب اثبات کامل میشود. همانطور که میبینید، هر دو شرط استقلال به یک رابطه مرکزی و متقارن $P(A \cap B) = P(A)P(B)$ منجر میشوند که در آن هیچ اثری از شرطیشدن (یعنی علامت "|") دیده نمیشود.

مثالهای عینی و روزمره از استقلال متقارن

برای درک بهتر این موضوع، بیایید به چند مثال ساده و علمی نگاه کنیم. مثال اول مربوط به پرتاب یک تاس سالم است. فرض کنید A پیشامد «آمدن عدد زوج» و B پیشامد «آمدن عدد بزرگتر از 3» باشد. فضای نمونه $\{1,2,3,4,5,6\}$ است. احتمالها را حساب میکنیم:

- $P(A) = \frac{3}{6} = \frac{1}{2}$

- $P(B) = \frac{3}{6} = \frac{1}{2}$

- $P(A \cap B) = P(\{4,6\}) = \frac{2}{6} = \frac{1}{3}$

حال بررسی میکنیم که آیا A از B مستقل است؟ $P(A|B) = \frac{P(A \cap B)}{P(B)} = \frac{1/3}{1/2} = \frac{2}{3}$. مشاهده میکنیم که $\frac{2}{3} \neq \frac{1}{2}$، بنابراین A و B مستقل نیستند. اما این مثال برای نشان دادن عدم استقلال بود. برای یک مثال از استقلال، فرض کنید A پیشامد «آمدن عدد زوج» و C پیشامد «آمدن عدد کوچکتر از 5» باشد. محاسبه میکنیم:

- $P(C) = \frac{4}{6} = \frac{2}{3}$

- $P(A \cap C) = P(\{2,4\}) = \frac{2}{6} = \frac{1}{3}$

مستقل بودن A از C یعنی $P(A|C) = P(A)$. $P(A|C) = \frac{1/3}{2/3} = \frac{1}{2}$ که دقیقاً برابر $P(A)$ است. پس A از C مستقل است. طبق خاصیت استقلال متقارن، باید C نیز از A مستقل باشد. بررسی میکنیم: $P(C|A) = \frac{P(C \cap A)}{P(A)} = \frac{1/3}{1/2} = \frac{2}{3}$ که دقیقاً برابر $P(C)$ است.

مثال دیگر در زمینه پزشکی: فرض کنید در یک جامعه، $10\%$ افراد به یک بیماری مبتلا هستند (پیشامد D). همچنین $40\%$ افراد دارای یک ژن خاص هستند (پیشامد G). اگر این دو پیشامد مستقل باشند، احتمال اینکه فردی هم بیمار باشد و هم آن ژن را داشته باشد، برابر است با $0.1 \times 0.4 = 0.04$. در این حالت، دانستن اینکه فردی بیمار است، هیچ اطلاعاتی درباره داشتن یا نداشتن آن ژن به ما نمیدهد ($P(G|D)=P(G)$) و بالعکس.

کاربرد عملی: چرا استقلال متقارن مهم است؟

خاصیت استقلال متقارن صرفاً یک ویژگی ریاضی جالب نیست، بلکه در عمل نیز بسیار حیاتی است. در علم آمار و یادگیری ماشین، وقتی ما فرض میکنیم دو متغیر تصادفی مستقل هستند، در حال ایجاد یک تقارن در تحلیل خود هستیم. این تقارن به ما اجازه میدهد تا توزیع توأم1 را به سادگی به صورت حاصلضرب توزیعهای حاشیهای2 بنویسیم: $P(A \cap B) = P(A)P(B)$. این رابطه در فرمولبندی مدلهای گرافیکی احتمالاتی، مانند شبکههای بیزی، نقش اساسی دارد.

برای مثال، در یک سیستم تشخیص هرزنامه (اسپم)، فرض میکنیم وقوع کلمات مختلف در یک ایمیل، با شرط هرزنامه بودن یا نبودن، از یکدیگر مستقل هستند (فرض سادهگرایانه اما مؤثر). این فرض که به «استقلال شرطی» معروف است، از همین مفهوم استقلال متقارن ریشه میگیرد و به ما امکان میدهد با وجود سادگی، به دقت خوبی در طبقهبندی برسیم. اگر این تقارن وجود نداشت و استقلال یکطرفه بود، محاسبات بسیار پیچیده و غیرعملی میشدند.

همچنین در نظریه بازیها، استقلال تصمیمات بازیکنان از یکدیگر اغلب با استفاده از این خاصیت مدلسازی میشود. اگر استراتژی بازیکن اول (پیشامد A) از استراتژی بازیکن دوم (پیشامد B) مستقل باشد، آنگاه به طور خودکار استراتژی بازیکن دوم نیز از استراتژی بازیکن اول مستقل خواهد بود. این امر تحلیل تعادلها را در بازیهای با اطلاعات کامل سادهتر میکند.

جدول مقایسه: استقلال در مقابل وابستگی

| ویژگی | پیشامدهای مستقل | پیشامدهای وابسته |

|---|---|---|

| احتمال شرطی | $P(A|B) = P(A)$ | $P(A|B) \neq P(A)$ |

| قاعده ضرب | $P(A \cap B) = P(A)P(B)$ | $P(A \cap B) = P(A)P(B|A)$ |

| خاصیت تقارن | دارد (همیشه برقرار) | ندارد (یکطرفه نیست) |

| مثال عددی | پرتاب یک تاس: $A=\{2,4,6\}$, $C=\{1,2,3,4\}$ | پرتاب یک تاس: $A=\{2,4,6\}$, $B=\{4,5,6\}$ |

چالشهای مفهومی

در این مقاله با مفهوم استقلال متقارن در نظریه احتمال آشنا شدیم. دیدیم که اگر دو پیشامد A و B دارای احتمال وقوع غیرصفر باشند، رابطه $P(A|B) = P(A)$ (مستقل بودن A از B) به طور مستقیم و ریاضی به رابطه $P(B|A) = P(B)$ (مستقل بودن B از A) منجر میشود. اثبات این خاصیت ساده و مبتنی بر تعریف احتمال شرطی و ضرب متقاطع بود. این تقارن به ما امکان میدهد تا به سادگی از مفهوم استقلال در قالب ضرب احتمالات استفاده کنیم و تحلیل مسائل پیچیدهتر در آمار، یادگیری ماشین و علوم دیگر را ممکن میسازد.